生成AIの爆発的な普及にともない、AIを動かす半導体チップの確保が国家的な課題となっています。現在、AI半導体市場はNVIDIAのGPUがほぼ独占していますが、1枚あたり数百万円という高コストと700Wを超える消費電力が深刻な問題です。そこで注目されているのが、スーパーコンピュータ「富岳」の技術を受け継いだ富士通の国産AI半導体(NPU)開発プロジェクトです。本記事では、富士通NPUの全貌と、NVIDIAのGPU・GoogleのTPUとの設計思想の根本的な違いをわかりやすく解説します。

なぜ今、日本独自のAI半導体が必要なのか

2024年以降、AI半導体をめぐる地政学リスクが急速に高まっています。米国の対中輸出規制によってサプライチェーンの不安定さが顕在化し、各国が「半導体主権(ソブリンチップ)」の確保に乗り出しました。日本政府も2030年度までに10兆円超の公的支援を打ち出し、経済産業省の2026年度予算では先端半導体・AI関連に1兆2,390億円(前年度比3.7倍)を計上するなど、国を挙げての取り組みが加速しています。

こうした動きの中心にいるのが富士通です。世界トップの性能を記録したスーパーコンピュータ「富岳」で培った省電力・高性能プロセッサ技術を基盤に、AI推論に特化した国産NPU(Neural Processing Unit)の開発を進めています。開発費約580億円のうち約2/3をNEDO(新エネルギー・産業技術総合開発機構)が補助する国家プロジェクトとして位置づけられています。

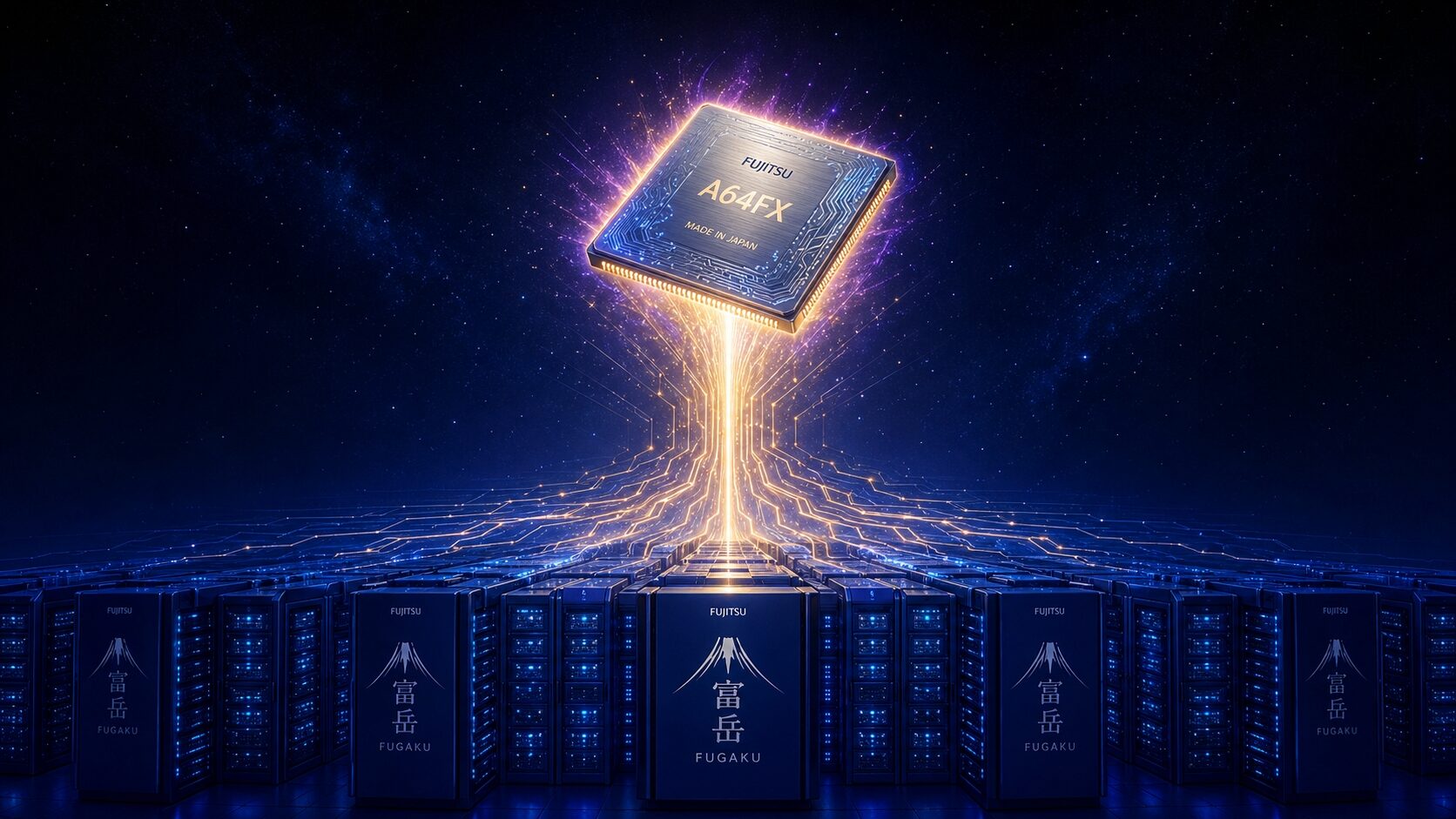

富岳とA64FXプロセッサ:NPUの土台となる技術的遺産

富士通NPUの技術的ルーツを理解するには、まずスーパーコンピュータ「富岳」の心臓部であるA64FXプロセッサの特徴を押さえる必要があります。

A64FXの革新的な設計

A64FXは48個の演算コアと4個の補助コアを搭載し、世界で初めてArm SVE(Scalable Vector Extension)を商用実装したプロセッサです。512ビット幅のSIMD演算により、倍精度で8演算、半精度で32演算を同時処理できます。さらに、HBM2メモリを4スタック搭載し、1,024 GB/sという圧倒的なメモリ帯域幅を実現しました。

富岳はこのA64FXにより、2020年にスーパーコンピュータの性能ランキング「TOP500」で世界1位を獲得しました。しかし、それ以上に重要なのは電力効率ランキング「Green500」でも常に上位を維持し続けたことです。TDP(熱設計電力)わずか約160Wで世界最高クラスの演算性能を達成した「1ワットあたりの性能を最大化する」という設計思想こそが、NPU開発に受け継がれる核心的な価値です。

NPUに継承される3つの技術的DNA

- 省電力設計の思想:制御回路を削減し、データが流れることで自動的に計算が進む「データフロー型」アーキテクチャにより、電力消費を極限まで抑制

- 高帯域メモリの知見:HBM2で培ったメモリ帯域確保のノウハウにより、データ転送がボトルネックにならない設計を実現

- 大規模並列通信の最適化:富岳の独自ネットワーク「Tofu D」(6次元メッシュ/トーラス)で蓄積したノード間通信の最適化技術を、AIデータセンターの設計に応用

富士通NPU・MONAKAシリーズのロードマップ

富士通はNPU単体ではなく、次世代CPU「FUJITSU-MONAKA」シリーズと一体化した段階的な開発戦略を展開しています。

3段階のロードマップ

第1段階:FUJITSU-MONAKA(2027年)は、TSMC 2nmプロセスで製造される144コア(36コア×4チップレット)のArm CPUです。ARMv9+SVE2命令セットに対応し、競合CPUの2倍の電力効率を目標としています。SRAMダイをコアダイの真下に3D積層するBroadcomの3.5Dパッケージング技術を採用し、メモリアクセスの電力消費を大幅に削減しています。

第2段階:FUJITSU-MONAKA-X(2029年)は、ラピダスの1.4nmプロセスで製造される予定のCPU+NPU統合プロセッサです。最大の特徴は世界初のサーバー用Arm SME2(Scalable Matrix Extension 2)の実装です。行列演算エンジンをCPUに内蔵することで、CPU単体でも低レイテンシなAI推論を実行できます。さらにNVIDIAのGPUと「NVLink Fusion」でシリコンレベルの密結合が可能です。

第3段階:FUJITSU-MONAKA-XX(2031年)は、CPUとNPUを完全に融合させた究極形です。さらなる性能向上と省電力化を追求します。

用途に応じたスケーラブルな構成

MONAKA-Xでは、処理するAIモデルの規模に応じて柔軟な構成を選択できます。

- 小規模LLM推論:CPU単体(SME2行列演算エンジン利用)

- 中規模LLM推論:CPU+NPU統合パッケージ

- 大規模LLM推論・学習:CPU+NPU+NVIDIA GPU(NVLink Fusion経由)

この段階的な拡張性は、必要な処理能力に見合ったハードウェア構成を選べるため、コストと電力の両面で最適化が可能になります。

NVIDIA GPUとの違い:汎用性 vs 省電力特化

現在のAI半導体市場で圧倒的なシェアを持つNVIDIA GPU。その最新世代であるH100/B200と富士通NPUは、設計思想が根本的に異なります。

NVIDIA GPUの強みと課題

NVIDIA GPUは、もともとゲームグラフィックス用に開発された汎用並列計算チップです。数千基のCUDAコアとTensor Coreを搭載し、学習から推論、科学計算まであらゆる用途に対応できる「万能選手」です。最大の武器は2006年から整備されてきたCUDAエコシステムで、PyTorchやTensorFlowなどほぼすべてのAIフレームワークが標準対応しています。

しかし課題も深刻です。最新のH100はTDP 700W(SXM5版)と消費電力が非常に大きく、Blackwell世代のB200ではさらに上昇しています。1枚あたり数百万円というコスト、そして地政学的なサプライチェーンリスクも無視できません。

富士通NPUとの決定的な違い

富士通NPUは「AI推論」に用途を絞り込むことで、NVIDIAとは正反対のアプローチを採ります。汎用性を捨てる代わりに、データフロー型アーキテクチャで制御回路を最小化し、1ワットあたりの推論性能を最大化します。NVIDIAが「何でもできる万能型」なら、富士通NPUは「推論を省電力で極める専門型」です。

興味深いのは、富士通がNVIDIAを敵視するのではなく、NVLink Fusionを通じて協調関係を構築している点です。NVIDIA CEO ジェンスン・ファン氏も「富士通のCPUとの接続で、新たなレベルの省エネ・高効率を実現できる」と評価しています。小規模な推論はCPU+NPUで省電力に処理し、大規模な学習や推論が必要な場合はNVIDIA GPUと連携するという、現実的な棲み分け戦略です。

Google TPUとの違い:クローズド vs オープン

GoogleのTPU(Tensor Processing Unit)は、もうひとつの有力なAI専用チップです。2015年から内部利用されており、Geminiなど大規模LLMの学習・推論を支えています。

TPUの特徴的な設計

TPUの心臓部は「シストリックアレイ」と呼ばれる128×128の格子状演算器です。データが格子の中を律動的に流れながら行列乗算を実行する構造で、テンソル演算に極限まで最適化されています。最新世代のTPU v6e(Trillium)は、前世代(TPU v5e)比で4.7倍の計算性能と67%のエネルギー効率向上を達成しました。

富士通NPUとTPUの根本的な違い

TPUと富士通NPUはどちらも「AI特化型」という点で共通していますが、アクセシビリティにおいて大きく異なります。

- 利用環境:TPUはGoogle Cloud専用で、AWSやAzure、オンプレミス環境では使えません。一方、富士通NPUはオンプレミスやソブリンクラウドなど柔軟に導入可能です

- ソフトウェア互換性:TPUはXLAコンパイラに依存し、TensorFlowやJAXとの組み合わせが前提です。富士通NPUはArmソフトウェアエコシステムを基盤としており、より広範なフレームワークへの対応を目指しています

- 戦略的意図:TPUがGoogleの自社サービス最適化を目的とするのに対し、富士通NPUは日本および同盟国の「デジタル主権」確保を掲げています

3者の設計思想を比較する:根底にある哲学の違い

NVIDIA GPU、Google TPU、富士通NPUの3者は、それぞれまったく異なる設計哲学に基づいて作られています。以下の比較表で全体像を整理します。

【3者比較表】

- NVIDIA GPU:設計思想は「汎用並列計算機」。命令駆動型のSIMD並列処理で学習・推論・HPCすべてに対応。CUDAエコシステムが業界標準。TDP 700W(H100)と高消費電力が課題

- Google TPU:設計思想は「ドメイン特化ASIC」。シストリックアレイで行列演算に特化し、大規模LLMで圧倒的な電力効率を発揮。ただしGoogle Cloud専用でエコシステムが閉鎖的

- 富士通NPU:設計思想は「省電力最優先の推論特化型」。データフロー型アーキテクチャでデータ移動を最小化し、1ワットあたりの推論性能を追求。純国産・ソブリンAI基盤が明確な差別化軸

注目すべきは、この3者が「競合」であると同時に「補完」の関係にもあることです。富士通はNVIDIA GPUとのNVLink Fusion連携を前提とした設計を進めており、推論の省電力化という自社の強みを活かしつつ、大規模学習ではNVIDIAの汎用性を借りるという現実的な共存戦略を採っています。

富岳NEXT:日本のAI覇権をかけた切り札

富士通NPUが最初に大規模実装されるのが、次世代フラッグシップスーパーコンピュータ「富岳NEXT」です。2025年6月に理化学研究所が富士通に基本設計を発注し、2030年頃の稼働を目標としています。予算規模は1,100億円超(現行「富岳」の開発実績に基づく概算)です。

富岳NEXTの驚異的な性能目標

- AI性能(FP16/BF16)GPUアクセラレーター部:150 EFLOPS以上(富岳比 約70.5倍)

- AI性能(FP8)GPUアクセラレーター部:300 EFLOPS以上

- AI性能(FP8 sparse)GPUアクセラレーター部:600 EFLOPS以上

- HPC性能(FP64)CPU部:48 PFLOPS以上

富岳NEXTは世界初の「ゼタスケール」HPC-AIプラットフォームを標榜しており、3,400台以上のノードにFUJITSU-MONAKA-XとNVIDIA GPUを搭載します。日本のフラッグシップスパコンとして初めてNVIDIA GPUを採用する点も画期的で、理化学研究所・富士通・NVIDIAの三者連携によるプロジェクトです。

製造を担うラピダスも着々と体制を整えています。北海道千歳市のIIM-1工場では2024年にパイロットラインが稼働し、2027年後半の2nm量産を目指しています。MONAKA-X向けの1.4nm製造には第二工場(2027年着工・2029年量産)が充てられる計画です。

まとめ:富士通NPUは日本のAI基盤を変えるか

富士通が開発を進める国産NPUは、スーパーコンピュータ「富岳」の省電力技術を受け継ぎ、AI推論に特化した独自の半導体です。NVIDIA GPUの汎用性やGoogle TPUのドメイン特化とは異なる「省電力推論」という明確なポジションを確立しようとしています。

記事のポイントを整理します。

- 富士通NPUは富岳A64FXの「1ワットあたりの演算性能を最大化する」設計思想を継承し、データフロー型アーキテクチャで推論の省電力化を追求

- MONAKAシリーズは2027年(2nm)→2029年(1.4nm、NPU統合)→2031年(完全融合)の3段階で進化

- NVIDIAとは競合ではなくNVLink Fusionを介した協調関係を構築し、用途に応じた棲み分けを実現

- Google TPUとはアクセシビリティで差別化。オンプレミス・ソブリンクラウドでの柔軟な利用が可能

- 2030年稼働予定の富岳NEXTで初の大規模実装。ラピダスの国内製造による純国産路線

富士通CTOのヴィヴェック・マハジャン氏は「AIの世界で一番強いCPUの位置を狙っている」と宣言しています。2029年のMONAKA-X登場時、NVIDIAやGoogleの技術がどこまで進化しているかは未知数ですが、「省電力」「純国産」「オープンな利用環境」という富士通NPUの差別化軸は、電力制約の厳しい日本において確かな意味を持ちます。AIの計算基盤をめぐる競争は、チップ単体の性能だけでなく、エネルギー効率とデジタル主権の観点から新たなフェーズに入っているのです。